Al despertarse una mañana de octubre, Ellis, una adolescente de 14 años de Texas (Estados Unidos), tenía varias llamadas perdidas y mensajes de texto con supuestas imágenes de ella desnuda que circulaban en las redes sociales, según reseña la AFP.

Las fotos falsas (basadas en su cara real y un cuerpo desnudo superpuesto) —expone la denuncia de esa agencia de noticias, que recoge el testimonio de la familia de la adolescente— habían sido enviadas a compañeros de clase que difícilmente pudieron imaginarse el engaño.

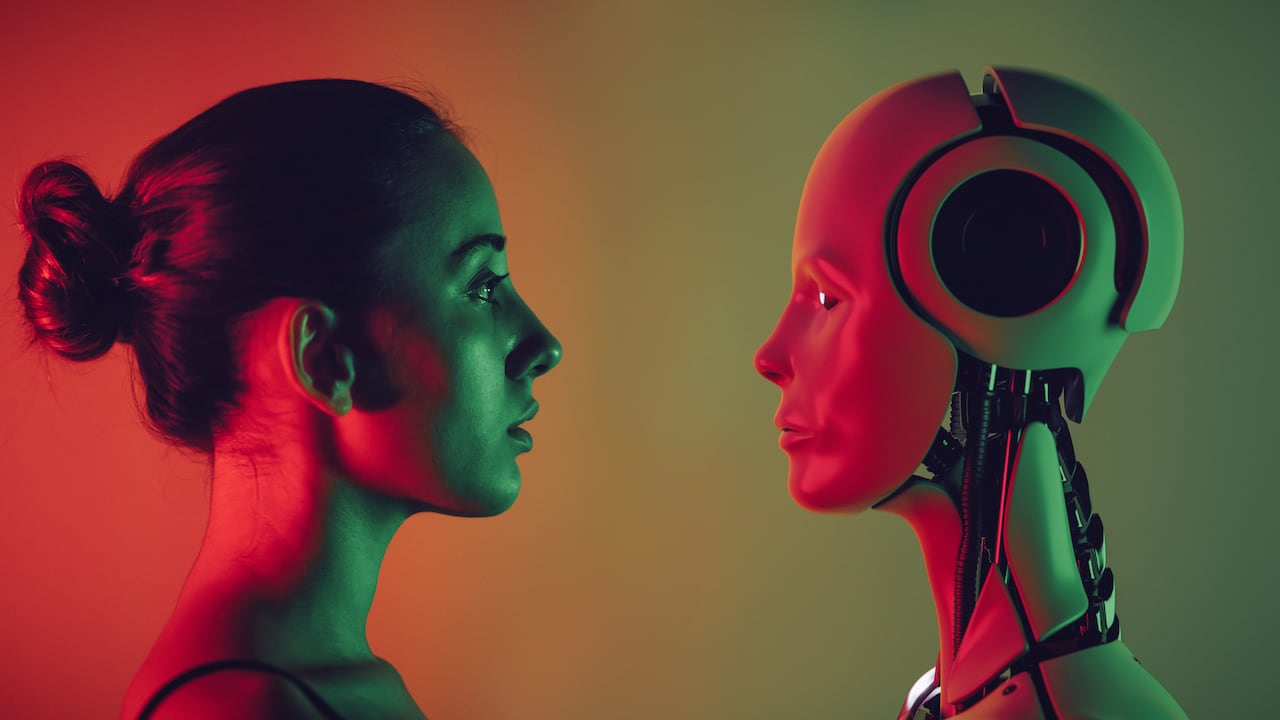

Y es que la inteligencia artificial (IA) hace que los llamados deepfakes (videos, imágenes o audios generados, que imitan la apariencia y el sonido de una persona) sean cada vez más realistas.

De acuerdo con el testimonio reseñado, las imágenes originales de Ellis y su amiga, que también fue víctima del mismo delito, fueron tomadas de sus cuentas personales de Instagram.

La estudiante de secundaria le contó a la AFP que no solo se trataba de fotografías de ellas, también de otras compañeras de clase, y que después de alteradas, esas fotos fueron compartidas en la aplicación móvil Snapchat.

“Parecía real, como si los cuerpos (desnudos) parecieran reales”, dijo la adolescente. “Y recuerdo haber estado muy, muy asustada”, le relató a AFP.

A medida que se desarrolla la IA, también lo hace la pornografía deepfake, con imágenes y videos hiperrealistas que pueden crearse con un mínimo esfuerzo y dinero, lo que ha provocado escándalos y acoso en varios centros de enseñanza secundaria de Estados Unidos.

Las autoridades intentan suplir la falta de una legislación federal que prohíba la práctica.

“Las niñas no paraban de llorar y llorar. Estaban muy avergonzadas”, declaró Anna McAdams, la madre de Ellis, quien se sorprendió de lo realistas que parecían las imágenes. “No querían ir al colegio”, recordó.

Un teléfono y unos dólares

La práctica se ha extendido, aunque no se sabe cuánto, explica la AFP. Cita, de hecho, que a finales del mes pasado estalló otro escándalo de desnudos falsos en un centro del estado nororiental de Nueva Jersey.

“Esto sucederá cada vez con más frecuencia”, afirmó a propósito Dorota Mani, madre de una de las víctimas, también de 14 años. Añadió que puede haber deepfakes pornográficos en internet de una persona sin que ella lo sepa y, por tanto, solo se investigan cuando las víctimas hablan.

“Muchas víctimas ni siquiera saben que hay fotografías y no podrán protegerse, porque no saben de qué”, se queja.

Según los expertos, citados por la agencia, la ley ha tardado en ponerse al día con la tecnología, pese a que desde hace años existen versiones más crudas de pornografía falsa, a menudo de personas famosas. Ahora, sin embargo, cualquier persona con una foto de LinkedIn puede ser víctima.

Se sabía “que se iba a utilizar de esta manera”, le declaró a la AFP Henry Farid, profesor de informática en la Universidad de California, Berkeley.

El mes pasado, el presidente estadounidense Joe Biden firmó un decreto sobre IA que le pide al gobierno generar barreras “contra la producción de material de abuso sexual infantil y contra la producción de imágenes íntimas no consensuadas de individuos reales”.

En muchos casos ha resultado difícil localizar a los creadores de algunas imágenes, pero eso no debería impedir que las empresas de inteligencia artificial detrás de ellas o las plataformas de las redes sociales donde se comparten rindan cuentas, estima Farid.

El problema es que no existe una legislación nacional que restrinja esta pornografía y solo un puñado de estados ha aprobado leyes que la regulan.

No es el único obstáculo. “Aunque se superponga tu cara a un cuerpo, el cuerpo no es realmente tuyo”, dijo Renee Cummings, especialista en ética de la IA. Esto puede crear una “contradicción en la ley”, LE explicó a la AFP el profesor de la Universidad de Virginia.

Según el experto, se puede argumentar que las leyes existentes que prohíben la distribución de fotografías sexuales de alguien sin su consentimiento no se aplican a los deepfakes.

Además, sostiene que quienquiera que tenga “un teléfono inteligente y unos pocos dólares” puede tomar las imágenes.

El lío también radica en que muchas de las víctimas, principalmente mujeres y adolescentes, “tienen miedo de hacerlas públicas”.

La pornografía deepfake “puede destruir la vida de alguien”, reconoció Cummings, citando a víctimas que han sufrido ansiedad, depresión y trastorno de estrés postraumático.

Trauma

En Texas, la policía interrogó a Ellis. Y la situación parece haber pillado desprevenidos a los sistemas educativo y judicial.

“Me destroza que no tengamos elementos para decir: ‘Sí, eso es pornografía infantil’”, dijo McAdams, su madre.

La compañera de clase que creó las fotos de Ellis fue expulsada temporalmente, pero la víctima dejó de ser sociable y extrovertida. Vive con “ansiedad” y ha pedido cambiarse de colegio.

“No sé cuántas personas podrían haber guardado las fotos y haberlas enviado. No sé cuántas fotos tomó”, dice. “Mucha gente podría haberlas conseguido”, explica.

A su madre le preocupa que las fotos puedan resurgir en internet porque podría “afectarles por el resto de sus vidas”.

Con información de AFP