Tecnología

Inteligencia artificial permite descubrir nuevas figuras en las Líneas de Nazca

El entrenamiento de estas herramientas le permite trabajar a la IA, 21 veces más rápido que un equipo humano.

Mientras el mundo se han enfrascado en un debate sobre la amenaza a la seguridad y estabilidad global que significa el desarrollo de la inteligencia artificial, hay varios sectores que han sabido sacarle provecho, como el de la ciencia, que ha venido utilizando estos avances para aplicarlos a diferentes investigaciones.

Pues bien, esto parece haber quedado claro luego de que un grupo de científicos utilizara herramientas de IA para que, luego de sobrevolar el suelo peruano, se pudieran encontrar nuevas líneas de Nazca, las cuales fueron grabadas hace 2.400 años.

La investigación estuvo a cargo del profesor de antropología y arqueología en la Universidad de Yamagata en Japón, Masato Sakai, quien lideró el grupo, que se ha caracterizado por buscar nuevos geoglifos de Nazca desde 2004.

En medio de sus labores, en las que se utilizan imágenes satelitales, drones, fotografía aérea y escaneo, fue con herramientas de inteligencia artificial que pudieron analizar las imágenes para poder trazar los antiguos dibujos escondidos en la tierra.

Aunque las imágenes de alta resolución fueron obtenidas en 2016, tuvieron que recurrir a algo que en el mundo de la inteligencia artificial es conocido como ‘aprendizaje profundo’ para que, ayudados por compañías como IBM Japón y el Centro de Investigación Thomas J. Watson de IBM, en los Estados Unidos, pudieran entrenar el sistema que les permitió identificar estas nuevas figuras.

El trabajo fue arduo, pues solo se contó con 21 patrones para entrenar a la inteligencia artificial que colaboró en el descubrimiento; sin embargo, esta permitió trabajar 21 veces más rápido que el ser humano, según lo explica la publicación en la revista Science Direct. “El modelo de machine learning analiza a gran velocidad el conjunto de datos visuales, al mismo tiempo que aprende a reconocer las características asociadas a las obras de arte grabadas o geoglifos”, asegura la investigación.

Nuevas líneas de Nazca descubiertas gracias a la inteligencia artificial https://t.co/cozsbU4PFp

— Marina (@marines42894509) June 8, 2023

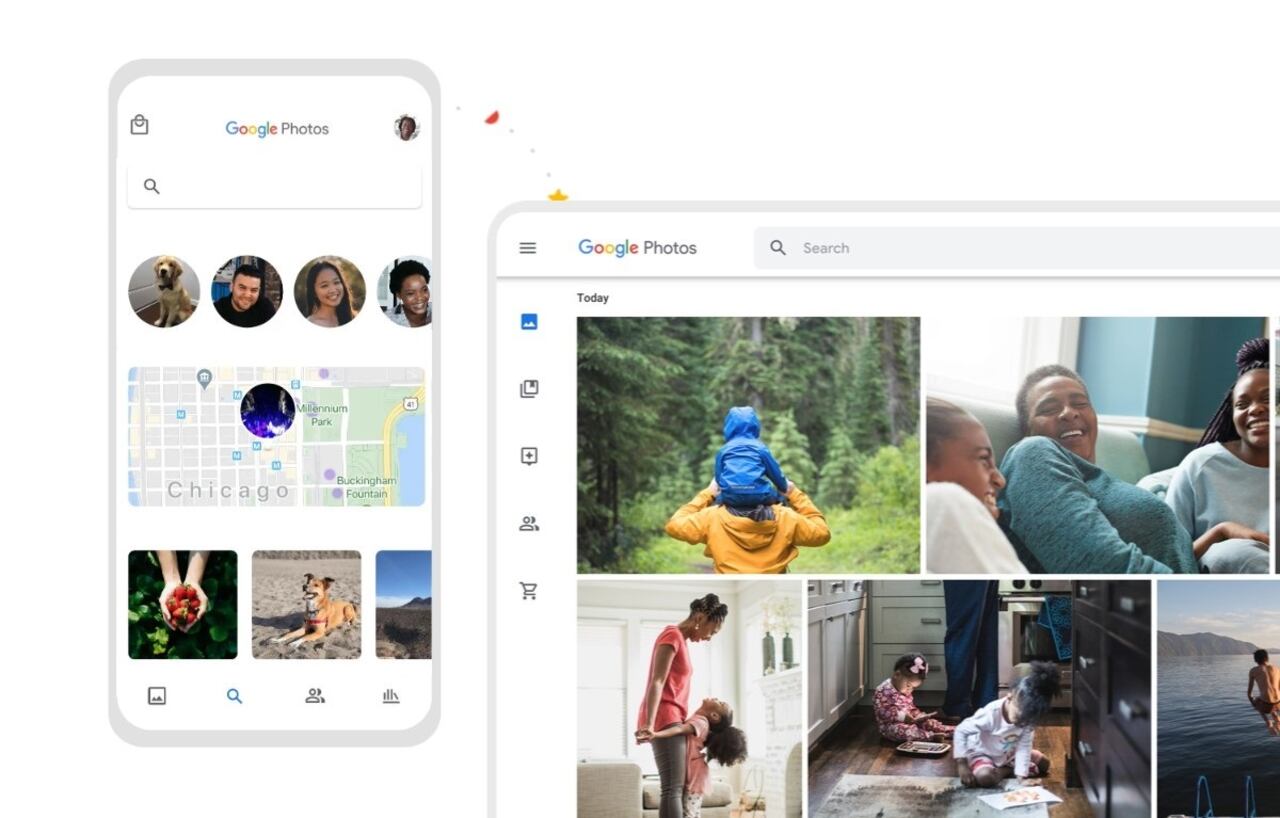

Google Fotos ahora es capaz de identificar a las personas en las imágenes, aunque estén de espaldas

En los últimos meses, Google Fotos ha estado implementando mejoras en la tecnología de reconocimiento facial, para así incrementar la capacidad de identificar personas en las imágenes. Pero próximamente contará con la facultad de reconocer a los usuarios que aparecen de espaldas y, por tanto, no muestran la cara.

La aplicación de almacenamiento de fotos del gigante tecnológico dispone de una tecnología de reconocimiento facial que analiza las caras que aparecen en las fotografías y etiqueta a las personas a las que pertenecen dichos rostros. Esta característica es útil para, por ejemplo, crear de forma automática una carpeta con todas las imágenes en las que aparece un usuario en concreto.

Hasta ahora, la app ha llevado a cabo esta función a través del análisis de los rostros de los usuarios. Sin embargo, la compañía parece haber mejorado la tecnología de reconocimiento facial impulsada por inteligencia artificial (IA) hasta el punto de ser capaz de reconocer personas que están de espaldas, tal y como han podido comprobar desde Android Authority.

Cuando una fotografía incluye a un usuario de espaldas o en una posición en la que no se puede ver bien su rostro, la aplicación no incluye a personas etiquetadas, ni permite añadir etiquetas de forma manual, ya que no identifica a ningún ser humano y, por tanto, no lo considera necesario.

No obstante, según detallan en este medio, la tecnología de Google Fotos ha sido capaz de detectar personas en posiciones en las que no muestran su rostro y etiquetar a dichos usuarios correctamente en la imagen. Además, esto ha ocurrido tanto en imágenes realizadas recientemente como en fotografías antiguas.

En estos casos, las etiquetas que facilita Google se muestran con el mensaje “rostro disponible para agregar” y, además, permite cambiar la persona etiquetada o eliminar la etiqueta, en caso de que su identificación no haya sido correcta.

A pesar de que Google no ha compartido información al respecto, este avance en el reconocimiento, puede deberse a que la tecnología de la compañía sea capaz de almacenar información de la cabeza al completo de los usuarios, a partir de videos en los que aparezca o fotos en las que sí se muestre la cara, aunque solo se distinga parte del rostro, tal y como ha apuntado Android Authority.

También pueden influir factores como la similitud de la ubicación con respecto a otras fotografías, en las que sí aparezca la cara de la persona o, incluso, otros factores como el entorno y la ropa utilizada. Todo ello enmarcado en las capacidades de aprendizaje automático de Google, en las que muestra avances continuos.